摘要:问境AIST首发:以AI治理AI,悬镜原创多模态AIST新品重磅发布...

随着大模型(LLM)加速从技术探索走向规模化应用,企业安全体系正面临一轮全新的挑战:AI生成代码是否可能埋藏未知缺陷甚至潜在后门?第三方引入的基础模型、开源组件和数据集,是否存在投毒、篡改或供应链风险?而在智能体(Agent)逐步参与业务执行的背景下,一次提示词注入、一次插件滥用,甚至一次越权调用,都可能引发敏感信息泄露、业务逻辑失控等安全问题。

在这样的背景下,悬镜安全正式推出问境AIST(AI Security Testing),基于原创多模态AIST技术,直击Agentic AI全生命周期过程中的原生安全风险,提供覆盖AI模型扫描、AI代码安全护栏、AI智能红队渗透与AI供应链安全情报预警一体化能力,赋能企业从传统软件供应链安全平滑迈向AI原生安全治理。

子芽:以AI治理AI,从传统软件供应链安全到AI原生安全

Gartner最新研究指出,随着生成式AI、智能体和第三方模型能力加速进入企业生产环境,企业需要将AI TRiSM(AI Trust, Risk and Security Management)应用于AI应用,覆盖第一方与第三方攻击面,并持续推进治理、监测、验证测试与合规能力建设。这意味着,AI原生安全正在从传统软件供应链安全体系中的新增项,快速演进为企业数字化治理体系中的技术底座。

尤其在金融、泛互联网、能源、电信运营商及大制造等行业,AI智能体(Agent)正日益嵌入核心流程,新增的攻击面(AI模型、智能体、MCP、Skills、AI供应链生态等)正给传统安全工具(AST/SCA/RASP等)带来新挑战,主要体现在:

黑盒化与不可观测性:模型决策过程的“黑盒”属性打破了传统的代码逻辑和日志审计模式,导致风险极具隐匿性。

交互范式的彻底变革:随着多模态、MCP(Model Context Protocol)、Skills及A2A(Agent to Agent)等新模式的涌现,提示词注入与插件滥用催生了更复杂的攻击面。

传统防护模型的瓦解:AI应用重构了IT架构,使得基于固定规则的传统检测响应模型在动态生成的AI逻辑面前难以为继。

供应链风险的指数级传递:开源生态与智能体架构加剧了对第三方模型和组件的依赖,任何底层的细微缺陷都可能引发系统性的安全崩塌。

数据安全敞口的全面放大:从训练数据到RAG(检索增强生成)私有库,数据全链路的深度介入放大了隐私泄露的风险。

“攻以守本,唯快不破”。悬镜首创基于“AI原生安全+DevSecOps敏捷安全+多模态SCA+AI供应链安全情报预警”技术的新一代AI数字供应链安全治理体系,以AI治理AI,从源头治理大模型开发、训练、部署到智能体运营等关键环节面临的AI原生安全风险,帮助企业用户构筑一套从传统软件供应链到AI原生供应链全生命周期的内生安全治理体系。

核心能力:全生命周期覆盖,构建AI原生安全治理体系

作为业内原创专利级新一代的多模态AIST治理平台,问境AIST秉持“安全左移”和“敏捷右移”的核心理念,通过五大核心能力,为企业构建起覆盖AI应用全生命周期的原生安全屏障:基于原创多模态AIST技术,通过AI模型扫描技术、AI代码安全护栏、AI智能红队渗透与AI供应链安全情报预警实现协同工作,为企业构建端到端的AI安全屏障,在享受Agentic AI的同时,从容应对新型安全风险。

穿透“数字黑盒”:让模型血缘与资产清单颗粒度可见

在AI应用的构建初期,最危险的风险往往源于对底层成分的“盲目信任”。传统的安全扫描通常止步于开源组件,却对Jupyter Notebook等开发环境及其中嵌套调用的模型接口视而不见。

问境 AIST引入了全要素资产指纹识别技术,如同为AI应用进行深度“CT扫描”,不仅审计代码逻辑,更能精准捕捉隐藏在项目中的本地或远程模型调用。基于此,问境AIST平台构建了AI-SBOM(AI软件物料清单)生成与分析能力。借助模型血缘分析技术,平台可自动化梳理出开源模型间的微调、量化及继承关系。

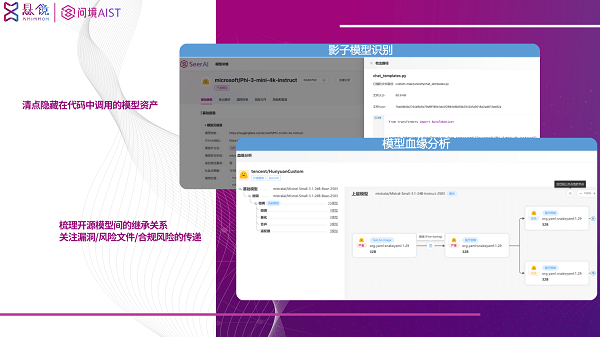

影子模型识别&模型血缘分析

针对PyTorch、Pickle、Transformers等11种以上主流模型格式,问境 AIST提供反序列化代码执行及风险配置的深度探测。这种深度的透明化治理,让安全官能够像审视账单一样掌控AI资产,使企业在面对基础模型或第三方组件爆出高危后门时,能秒级定位受影响的应用链路,实现风险的全路径追溯。

筑牢“Vibe Coding安全边界”:让AI代码安全护栏成为第一道防线

AI应用的很多风险,并不是上线后才暴露,而是在代码生成、依赖引入、提交构建乃至发布过程中就已埋下。提示词拼接不当、模型调用失控、插件接入过宽、密钥硬编码、影子模型混入项目,都会随着研发流程持续传递和放大,也让开发阶段成为AI原生安全治理最关键的起点。

问境AIST面向AI辅助开发与AI数字供应链,构建覆盖代码生成、引入、提交、构建、发布等关键环节的代码安全护栏体系。依托大模型能力,并结合静态分析、软件成分分析与供应链安全检测技术,平台不仅可识别传统漏洞与敏感信息泄露,还可针对提示词注入、提示词泄漏、不安全工具调用、影子模型接入、外部API滥用等AI特有风险进行精准检测,实现对风险代码的事前识别、事中拦截与事后修复。

这种护栏式能力,本质上是在研发源头为AI应用建立持续生效的安全边界,让企业从模型接入、提示词编排到工具调用,都能将安全纳入开发流程之中,为AI应用打下更稳健、更可控的交付基础。“魔法打败魔法”:攻防队等下的智能化红队实战验证

面对AI生成的动态逻辑,僵化的规则库在千变万化的诱导攻击面前已然失效。在应用上线前的关键窗口,问境AIST将安全验证带入“以AI治理AI”的新境界。

问境AIST平台面向OWASP Top 10 for LLM Applications所覆盖的典型风险场景,支持对提示词注入、越狱诱导等攻击方式进行自动化安全验证。结合自动化验证与无害化测试思路,平台可帮助企业更直观地识别风险触发路径,提升AI应用上线前的安全评估效率。

智能化红队实战验证

如此一来,业务部门在应用上线前,便能完成一场高强度的压力测试。 这确保了模型在复杂的实际交互中,不会因为一段看似无害的提示词而产生偏见言论或泄露核心业务指令。这种量化的安全评估,本质上是为AI应用披上了一层应对逻辑攻击的“原发性抗体”。

情报驱动先知:云脉XSBOM实现小时级风险响应

在AI安全的博弈中,响应速度决定治理成效。问境AIST底层由云脉XSBOM风险情报引擎实时驱动,构建起收录数百万级AI特有漏洞、投毒数据集及风险指纹的“先知体系”。

这套系统最核心的能力在于情报与企业资产的自动化关联映射。当全球范围内出现针对特定AI框架的0Day攻击或组件投毒事件时,情报系统会即刻触发警报,并精准映射到企业内部受影响的资产清单上。

云脉XSBOM小时级风险响应

这种先验式的预警能力,让企业始终握有防御先机。 安全团队能够抢在攻击者发起渗透前拿到“挂图作战”的防御图谱,并获得精确到代码行的修复指引。问境将安全响应从“被动补漏”转变为“主动先验”,助力企业在风云变幻的AI技术浪潮中始终保持稳健的防御姿态。

植入“代码疫苗”:从外挂式防护进化为内生自免疫

应用投产后,安全不应成为阻碍业务交互的“刹车”,而应进化为如影随形的数字化卫兵。

问境AIST将悬镜专利级“智能代码疫苗”技术嵌入AI应用运行环境,依托轻量化探针实现对运行过程的持续检测与防护。系统不再局限于静态规则匹配,而是结合应用逻辑与交互上下文识别潜在恶意行为;针对智能体(Agent)的插件调用与外部API访问,平台还可提供运行时可观测性,帮助安全团队定位异常调用、敏感数据暴露及越权操作等风险。

智能体运行时审计

基于这一机制,企业能够更高效地识别敏感信息泄露、恶意指令诱导等运行时安全问题,在不影响业务迭代效率的前提下提升AI应用的安全可控性。对安全团队而言,平台不仅提升了运行阶段的风险发现能力,也增强了对AI应用行为的持续治理能力。

在开发习惯向AI全面转向的今天,安全不应是限制创新的枷锁,而应成为保障智能涌现的基石。问境AIST秉持“以AI治理AI”的技术理念,将自免疫力植入智能应用的每一个细胞,确保每一个智能体(Agent)都能在可信、受控的轨道上全速奔跑。

以AI治理AI,聚焦Agentic AI全生命周期原生安全治理。问境 AIST 的诞生,正是AI智能化时代数字供应链底层逻辑的跃迁时刻,为企业智能化转型构建新一代 AI 数字供应链安全体系。